Este conteúdo faz parte da newsletter IAí?, que existe para te guiar no universo da inteligência artificial. Assine aqui para receber toda terça-feira no seu e-mail.

Pais e educadores ainda tentam lidar com o impacto das redes sociais e já enfrentam outro desafio: a convivência de adolescentes com a inteligência artificial. Ferramentas como o ChatGPT já funcionam como “conselheiras”, cúmplices e forma de “colar” em tarefas escolares. São interações que, segundo especialistas, trazem alguns riscos.

Nos EUA, um caso trágico acendeu um alerta. Adam Raine, de 16 anos, conversou por meses com o ChatGPT sobre automutilação antes de tirar a própria vida. A família processa a OpenAI e o CEO Sam Altman, alegando que o sistema validou pensamentos suicidas e sugeriu métodos de autoagressão.

Depois do caso, a OpenAI afirmou estar “profundamente entristecida” e prometeu reforçar a segurança. Agora, semanas depois, anunciou novos recursos de segurança: o controle parental para o ChatGPT. Isso significa que os pais podem vincular as contas dos seus filhos, definir limites de uso e receber alertas em casos de interações sensíveis, entre outras funcionalidades.

No Brasil, o lançamento ocorre semanas após a sanção do Estatuto da Criança e do Adolescente Digital (ECA Digital), que poderá obrigar as empresas de IA a adotar mais mecanismos de segurança. A seguir, entenda os principais riscos e os usos problemáticos de IA por adolescentes, como acionar (e quais as críticas sobre) o controle parental do ChatGPT e o que irá mudar nas regras com o ECA Digital.

Um dos principais riscos é o vínculo afetivo que adolescentes formam com a IA. Ao tratar o ChatGPT como confidente, eles tendem a ter percepções confirmadas, o que é uma característica do próprio sistema. O psiquiatra Gustavo Estanislau alerta que isso pode cristalizar inseguranças e afastar os jovens de diálogos reais. Em casos graves, como pensamentos delirantes, a IA pode reforçar distorções e agravar quadros.

- Tendência? Como funciona o Vibes e por que Mark Zuckerberg inventou um feed só com vídeos de IA

O problema também aparece no contexto escolar. O uso da IA para “colar” em tarefas compromete o aprendizado, que exige síntese, argumentação, pensamento crítico e participação ativa. Sem isso, o uso da IA mina o processo de aprendizagem. Estanislau explica que, ao pular etapas, o adolescente também deixa de desenvolver senso de autonomia e autoestima:

— O processo de aprendizado nos expõe a uma série de desafios e frustrações. Se eu utilizo a IA, eu não vivo a adaptação a esses processos que podem ser desafiadores, mas que são fundamentais para uma base sólida para lidar com os desafios da vida — afirma o pesquisador, que atua no Instituto Ame Sua Mente.

- Quer receber a newsletter de IA no seu e-mail? Inscreva-se no cardápio do GLOBO

Laura Hauser, pesquisadora e doutoranda da PUC-SP, reforça que essa lógica é paradoxal, já que usar a IA como esse atalho na escola mina justamente competências humanas que mais devem ser valorizadas e relevantes em um mundo transformado pela própria inteligência artificial — é o caso da criatividade e do pensamento crítico.

2. Controle parental: as limitações

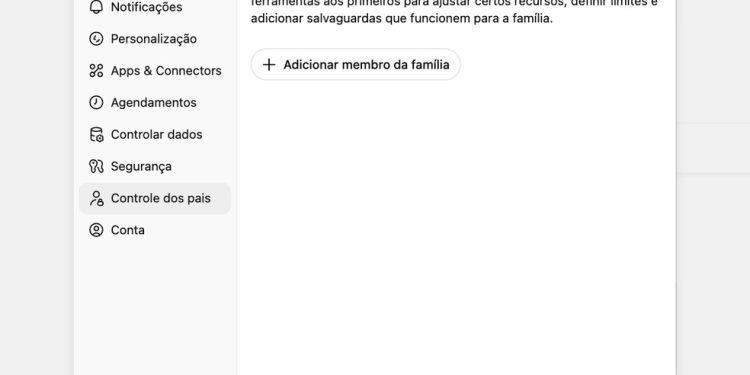

O recurso de controle parental do ChatGPT cobre apenas parte dos dilemas da IA na adolescência, com foco em conteúdos perigosos. Ele pode ser ativado nas configurações: o responsável envia um convite ao adolescente e, após o aceite, as contas ficam vinculadas. A partir daí, os pais têm acesso a um painel de controle.

Nele, é possível definir horários de uso, desativar o modo de voz, impedir a geração de imagens e desligar a “memória” do ChatGPT, que guarda informações de conversas anteriores para personalizar a interação. Filtros automáticos também são aplicados com redução de material gráfico; bloqueio de desafios virais; proibição de simulações sexuais, românticas ou violentas; e limitação de ideais de beleza extremos.

A conta do adolescente também passa a ter monitoramento em caso de interações que indiquem automutilação ou pensamentos suicidas. Nesses casos, uma equipe interna da OpenAI analisa as mensagens e, se considerar necessário, notifica os responsáveis por e-mail, SMS e aplicativo.

Em teste do Washington Post, o colunista Geoffrey Fowler, pai de uma adolescente, mostrou que levou menos de cinco minutos para burlar o controle parental, criando outra conta. A OpenAI reconhece que as medidas não são infalíveis – o adolescente só está sujeito a essas configurações ao usar a IA logado na conta vinculada aos pais. Além de criar outra conta, também é possível usar a IA no modo anônimo, sem logar.

3. Chegada do ECA Digital: o que vai mudar

Para Kelli Angelini, cofundadora do Instituto Educando Direito, o controle parental de o ChatGPT é um passo importante, mas com limitações. Um dos problemas do sistema é a falta de mecanismos de aferição de idade, diz. Apesar do ChatGPT ter idade mínima de 13 anos, não há um sistema eficaz de verificação. Angelini destaca que o ECA Digital, que entra em vigor em março de 2026, no entanto, pode mudar esse cenário:

— Hoje, é fácil burlar (o controle parental) porque é possível que o adolescente ou criança façam outra conta sem vinculação com os pais. Com o ECA Digital, as plataformas terão que criar sistemas de aferição de idade.

- Por que até as IAs ‘alucinam’? Resposta pode estar na obsessão por acertar

Atualmente, o sistema de checagem de idade nas plataformas digitais, inclusive as de IA, é majoritariamente autodeclaratório. A advogada Núria López, cofundadora da Technoethics e sócia da Daniel Advogados, no entanto, ressalta que não está claro como os novos mecanismos de verificação serão implementados:

— O ECA Digital vale para todas as aplicações acessíveis para crianças e adolescentes e veda a autodeclaração de idade. Mas ainda precisamos entender como será interpretada essa abrangência da lei.

López ressalta que o controle parental da OpenAI antecipa parte das exigências do ECA Digital ao criar um painel de controle para os responsáveis — modelo que, a partir de março, será obrigatório para todas as plataformas. Ela lembra ainda que a empresa está desenvolvendo um sistema para identificar automaticamente interações com menores de 18 anos. Nesses casos, as restrições de conteúdo são automáticas.

Para as especialistas, proteger crianças e adolescentes no uso da inteligência artificial exige corresponsabilidade. López lembra que “o melhor interesse do menor é compartilhado por toda a sociedade”, e que o papel das plataformas será mais regulado com o novo ECA. Angelini ressalta que nenhum controle automático é suficiente, e que os pais e educadores ainda vão precisar orientar e monitorar o uso da tecnologia.